浅谈深度学习基础(下)

CNN、RNN和LSTM

卷积神经网络(Convolutional Neural Network,CNN)

1984年,日本学者福岛基于感受区域概念提出了神经认知机。神经认知机可以看作是卷积神经网络的第一个实现网络,也是感受区域概念在人工神经网络领域的首次应用。神经认知机将一个视觉模式分解成许多feature,然后进入分层递阶式相连的feature maps进行处理,这样就可以将视觉系统模型化,使其能够在物体有位移或轻微变形的时候,也能完成识别。

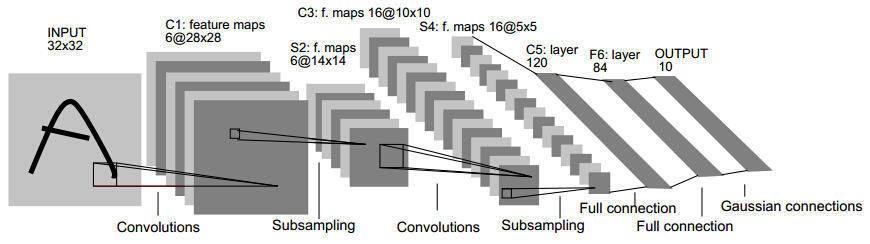

我们以用于手写数字识别的LeNet-5为例来讲卷积神经网络。

卷积神经网络由卷积层(Convolutions Layer)、池化层(Pooling Layer)和全连接层构成。全连接层在最后,前面是若干卷积层和池化层,每个卷积层后面跟一个池化层,如此重复。

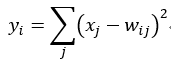

图中展示了LeNet-5网络的结构,一共七层,前面四层是卷积层和池化层(池化层又叫子采样层,也即Subsample Layer),后面三层是全连接层,最后一层输出层是高斯连接层,也是全连接层,共有10个节点,分别代表数字0到9,且如果节点i的值为0,则网络识别的结果是数字i。采用的是欧式径向基函数(ERBF)的网络连接方式。假设x是上一层的输入,y是ERBF的输出,则ERBF输出的计算方式是:

理解卷积神经网络的核心在于理解前面的卷积层和池化层。既然我们将卷积神经网络分为了卷积层、池化层和全连接层,则隐含了前面的卷积层和池化层并不是全连接的,那它们是怎么连接的呢?

介绍连接方式之前需要先介绍卷积层与池化层的性质:

卷积层:卷积层由若干张feature map(FM)构成。对输入数据应用卷积核(可以认为是对特定feature非常敏感的探测器),在输入数据上滚一遍我们的卷积核,就得到了一张FM,FM上记录了卷积核在原图不同区域的激活程度(与该卷积核的feature越契合,激活程度越高),也即去掉了读不懂的数据,留下了符合一定feature的数据。每个卷积核拥有一个feature,也就能产生一张对应feature的FM。

池化层:池化层的价值在于缩减输入数据的规模,FM上k*k一共k^2个激活值合并成为池化层上的一个激活值,合并的方法有很多种,比如最大值合并、平均值合并及随机合并,需要视情况而定,比如如果要确定『有没有』的问题,就要采用最大值合并,把最高的激活值保留下来。

然后最后一个池化层后面连接到一个或多个全连接层,全连接层的输出就是最后的输出。训练过程通过改进的反向传播实现,在反向传播的时候需要特别考虑到池化层合并激活值的方法,最大值合并、平均值合并等,均需要采用特定的处理方法,并以此来更新卷积核。

我们能人工定义的是卷积核的宽和高,还有卷积核的个数。卷积核对什么feature敏感,是先随机初始化,再经过BP算法慢慢训练出来的,卷积核的权重就是卷积神经网络主要需要学习的参数。

卷积神经网络通过『参数减少』与『权值共享』大大减少了连接的个数,也即需要训练的参数的个数。

就拿原图像到第一层卷积层的连接举例,假设我们的图像是1000*1000的,则有10^6个隐层神经元,那么它们全连接的话,也就是每个隐层神经元都连接图像的每个像素点,就有10^12个连接,也即10^12个权值参数需要训练,这显然是不值得的。但是对于一个只识别特定feature的卷积核,需要大到覆盖整个图像的所有像素点吗?通常是不需要的,一个特定feature,尤其是第一层需要提取的feature,通常都相当基础,只占图像很小的一部分。所以我们设置一个较小的局部感受区域,比如10*10,也即每个神经元只需要和这10*10的局部图像相连接,所以10^6个神经元也就有10^8个连接。这就叫参数减少。

那什么叫权值共享呢?在上面的局部连接中,10^6个神经元,每个神经元都对应100个参数,所以是10^8个参数,那如果每个神经元所对应的参数都是相同的,那需要训练的参数就只有100个了。

这后面隐含的道理在于,这100个参数就是一个卷积核,而卷积核是提取feature的方式,与其在图像上的位置无关,图像一个局部的统计特征与其他局部的统计特征是一样的,我们用在这个局部抽取feature的卷积核也可以用在图像上的其它任何地方。

而且这100个参数只是一种卷积核,只能提取一种feature,我们完全可以采用100个卷积核,提取100种feature,而所需要训练的参数也不过10^4,最开始我们训练10^12个参数,还只能提取一种特征。选取100个卷积核,我们就能得到100张FM,每张FM可以看做是一张图像的不同通道。

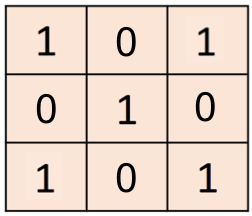

接下来我要具体介绍一下利用卷积核卷积生成FM的过程:

左侧绿色的是5*5的原图,左侧黄色的是3*3的卷积核覆盖的区域,右侧是3*3的FM。

时间:2018-08-07 23:13 来源: 转发量:次

声明:本站部分作品是由网友自主投稿和发布、编辑整理上传,对此类作品本站仅提供交流平台,转载的目的在于传递更多信息及用于网络分享,并不代表本站赞同其观点和对其真实性负责,不为其版权负责。如果您发现网站上有侵犯您的知识产权的作品,请与我们取得联系,我们会及时修改或删除。

相关文章:

- [机器学习]Facebook新AI模型SEER实现自监督学习,LeCun大赞最有

- [机器学习]一文详解深度学习最常用的 10 个激活函数

- [机器学习]增量学习(Incremental Learning)小综述

- [机器学习]盘点近期大热对比学习模型:MoCo/SimCLR/BYOL/SimSi

- [机器学习]深度学习中的3个秘密:集成、知识蒸馏和蒸馏

- [机器学习]【模型压缩】深度卷积网络的剪枝和加速

- [机器学习]堪比当年的LSTM,Transformer引燃机器学习圈:它是

- [机器学习]深度学习三大谜团:集成、知识蒸馏和自蒸馏

- [机器学习]论机器学习领域的内卷:不读PhD,我配不配找工

- [机器学习]芯片自主可控深度解析

相关推荐:

网友评论: