用人工神经网络控制真实大脑,MIT的科学家做到

三位研究者分别是 MIT 大脑与行为科学系主任 James DiCarlo、MIT 博士后 Pouya Bashivan 和 Kohitij Kar。相关论文发表在 5 月 2 日 Science 的网络版上。

论文链接: http s://www.biorxiv.org/content/10.1101/461525v1

研究人员表示,他们最初的目的是探索大脑如何感知和理解视觉世界。为此,他们创建了可以模拟大脑视觉皮层的计算模型。但仅仅创建模型是不够的,他们还想知道自己创建的模型是否准确。

于是,他们尝试用创建的模型控制神经元,测试他们的模型能否精确地控制单个神经元以及视觉神经网络中的神经元群。这是一项非常严格的测试。

他们将自己创建的计算模型称为「controller」,用这一模型控制另一个系统的输出,也就是实验中猴子大脑的神经活动。

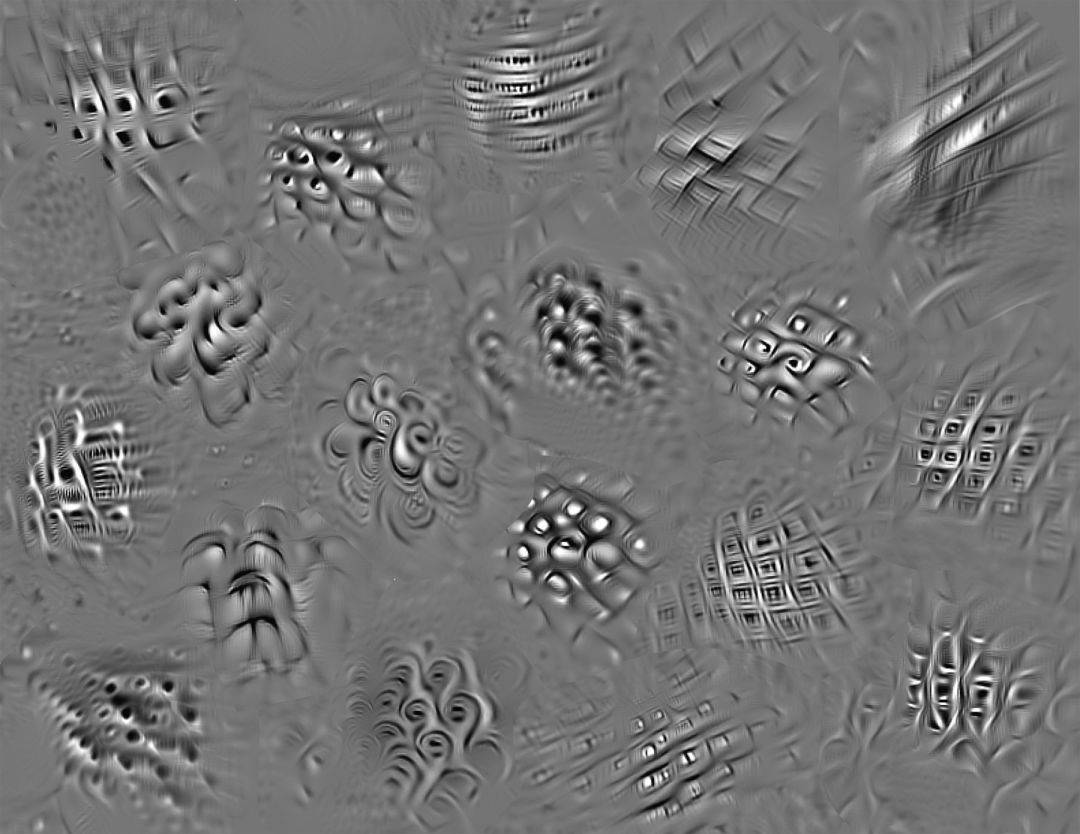

首先,他们利用从该计算模型中获得的信息创建了特定的图像。这些图像与自然图像存在很大的差别,如下图所示。

研究人员利用深度神经网络模型合成的图像。

研究人员将这些图像展示给实验中的猴子,观察图像是否可以强烈激活他们选择的特定脑神经元。

实验结果表明,这些图像可以强烈激活他们选择的特定脑神经元。也就是说,他们利用自己创建的人工神经系统成功控制了真实神经系统的活动。

实验步骤

过去几年里,DiCarlo 及其他人开发出了基于人工神经网络的视觉系统模型。每个网络开始时具有一个包含模型神经元或节点的任意架构,这些不同强度(也可称权重)的神经元或节点彼此之间可以相互连接。

随后,研究者在一个拥有 100 多万张图像的库中训练这些模型。当研究者向模型展示每张图像,并给图像中最突出的物体添加标签(如飞机或椅子等)时,模型通过改变其连接强度来学习识别物体。

虽然很难准确确定模型如何实现这种识别,但 DiCarlo 及其同事之前已经证实了这些模型中的「神经元」产生的活动模式与动物视觉皮层对同一图像的反应非常相似。

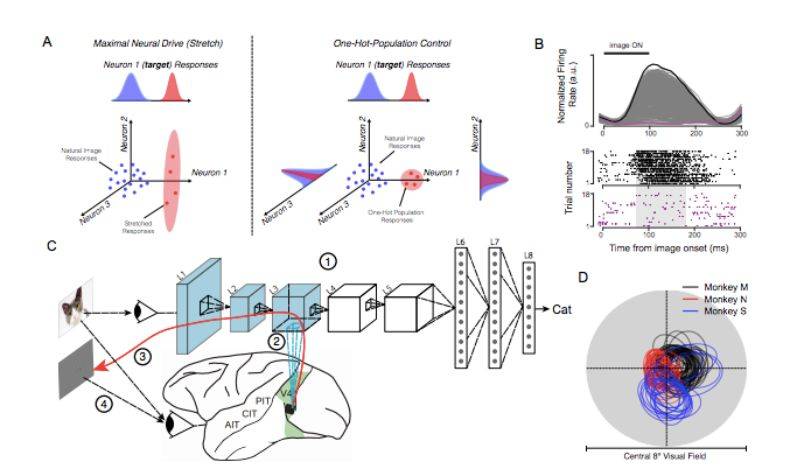

研究者设计了几个闭环的神经生理学实验:在将模型神经元与每个记录的大脑神经位点匹配之后,他们使用模型合成了全新的「controller」图像。接下来,他们将这些图像展示给每个目标,以测试模型控制目标神经元的能力。

在一项测试中,研究人员让模型尝试控制每个大脑神经元,使其激活程度超过其平时观察到的最大激活水平。他们发现,模型生成的合成刺激成功地驱动 68% 的神经位点超出了它们的自然观察激活水平。

在一项更加严格的测试中,研究人员试图生成能够最大限度地控制一个神经元的图像,同时保持附近神经元的活跃度非常低,这是一项更加困难的任务。

但这没有难倒他们。对于测试的大多数神经元,研究人员能够增强目标神经元的活跃度,而周围神经元的活跃度几乎没有增加。

接下来,研究者利用这些非自然合成的 controller 图像来测试模型预测大脑反应的能力是否可以适用于这些全新的图像。结果表明,模型非常准确,预测到了 54% 的图像诱发的大脑反应模式,不过这还不够完美。

「此前,模型已经能够预测神经对其他未见过的刺激的反应,」Bashivan 表示。「这里主要的不同之处在于我们又往前走了一步,即利用模型控制神经元达到我们想要的状态。」

为了达到这一目标,研究人员首先在计算模型中创建了大脑 V4 视觉区域神经元到节点的一对一映射。他们通过向动物和模型展示图像,并比较它们对相同图像的反应来实现这一目的。V4 区有数百万个神经元,但在这项研究中,研究人员每次只创建 5~40 个神经元的映射。

「一旦搞清楚了每个神经元的分工,模型就能对神经元做出预测。」DiCarlo 表示。

研究人员开始研究能否利用这些预测来控制视觉皮层单个神经元的活动。他们用到的第一种控制叫做「stretching」,包括展示一幅将会控制某个特定神经元的图像。

研究人员发现,当他们向动物展示这些由模型创建的非常规「合成」图像时,目标神经元的确做出了预期的反应。平均而言,这些神经元对合成图像的反应要比它们看到用于训练模型的自然图像时活跃 40% 左右。这种控制方法也是首创性的。

「实验数据收集和计算建模分开进行是神经科学的一个普遍趋势,这使得模型验证非常少,因此缺乏可量化的进展。我们的工作使这一『闭环』方法」重获生机,将模型预测和神经测量都包含进来,这些对成功构建和测试最接近大脑的模型至关重要,」Kar 表示。

图 1:合成步骤概览。A) 两个受测控制场景的图示。C) 神经控制实验具体步骤。D) 猴子 M(黑色)、N(红色)和 S(蓝色)的神经位点感受野。其中 C 展示了神经控制实验的四个步骤:在大量标注自然图像上训练神经网络,以优化其参数,然后保持不变;将 ANN「神经元」映射到每个记录的 V4 神经位点;使用得到的可微模型合成「controller」图像,用于 single-site 或群体控制;将这些图像指定的发光模式应用于受试者的视网膜,衡量神经位点的控制水平。

证明用人工神经网络理解真实神经网络的可行性

实验结果表明,当前这些模型与大脑非常类似,可用于控制动物的脑状态。James DiCarlo 称,该研究还有助于确定这些模型的有用性,而这引起了它们是否可以精确模拟视觉皮层工作的激烈争论。

他还说道:「人们对这些模型是否可以理解视觉系统提出了质疑。抛却学术意义上的争论,我们证实了这些模型已经足够强大,能够促成一项重要的新应用。无论你是否理解该模型的工作原理,从这层意义上来说已经很有用了。」

「他们做到的这一点真的很棒。就好像那副理想的图像突然抓住了那个神经元的注意力。那个神经元突然找到了它一直以来寻找的刺激,」匹兹堡大学生物工程学副教授 Aaron Batista 表示。「这个想法非常了不起,将其变为现实更加了不起。*这可能是用人工神经网络理解真实神经网络迄今为止最有力的证明*。」

研究成果有望用于治疗抑郁症

研究者表示,对于那些想要研究不同神经元如何相互作用和如何连接的神经科学家来说,这种控制可能有用。在遥远的未来,这种方法有可能在治疗抑郁症等情绪障碍中发挥作用。目前,研究者正在研究将他们的模型扩展至为杏仁体提供养料的颞下皮层,而杏仁体又涉及到情绪处理。

Bashivan 表示:「如果我们有一个优秀的神经元模型,它可以体验情绪或引发不同种类的失调,我们就可以使用该模型控制神经元,来帮助缓解失调状况。」

参考链接:

http://news.mit.edu/2019/computer-model-brain-visual-cortex-0502

https://science.sciencemag.org/content/364/6439/eaav9436

https://www.biorxiv.org/content/10.1101/461525v1

时间:2019-05-10 00:05 来源: 转发量:次

声明:本站部分作品是由网友自主投稿和发布、编辑整理上传,对此类作品本站仅提供交流平台,转载的目的在于传递更多信息及用于网络分享,并不代表本站赞同其观点和对其真实性负责,不为其版权负责。如果您发现网站上有侵犯您的知识产权的作品,请与我们取得联系,我们会及时修改或删除。

相关文章:

- [机器学习]人工智能十年回顾:CNN、AlphaGo、GAN……它们曾这

- [机器学习]20年以后,半数工作将被人工智能取代?这些“高危行业”有哪些

- [机器学习]人工智能十年回顾:CNN、AlphaGo、GAN……它们曾这

- [机器学习]年终总结:2021年五大人工智能(AI)和机器学习(ML)发展趋势

- [机器学习]神经科学如何影响人工智能?看DeepMind在NeurIPS2

- [机器学习]美俄人工智能军事应用

- [机器学习]民调不靠谱?人工智能预测拜登获胜

- [机器学习]人工智能正在误导我们的广告,是时候纠正这些错误了

- [机器学习]美国陆军研究如何组建人-人工智能系统团队

- [机器学习]从零开始构建简单人工神经网络:1个输入层和1个输出层

相关推荐:

网友评论: